Что не подходит для определения понятия информация

Вопрос Понятия «сведения», «данные» и «информация». Различия в подходах к определению информации. 8Критерии полноты информации (целостности данных).

Атрибутисты полагают, что информация как семантическое (смысловое) свойство материи является неотъемлемым атрибутом всех элементов и систем объективной реальности. Информацию несут не только испещренные буквами листы книги или человеческая речь, но и солнечный свет, складки горного хребта, шум водопада, шелест травы. Информация не может существовать вне материи, а значит, она существовала и будет существовать вечно.

Функционалисты отрицают существование информации в неживой природе. По их мнению, информация через информационные процессы реализует функцию управления (самоуправления) в биологических, социальных и социотехнических системах, т. е. информация – это одна из функций жизни, основное отличие живого от неживого.

Антропоцентристы ограничивают сферу информации главным образом социальными системами. В этом подходе информация трактуется как активная, «полезная» часть человеческих знаний, т.е. тех знаний, которые используются для ориентировки, управления и пр. Такую информацию можно понимать как содержание (смысл) сигнала, полученного системой из внешнего мира.

Целостность информации (также целостность данных) — термин в информатике и теории телекоммуникаций, который означает, что данные полны, условие того, что данные не были изменены при выполнении любой операции над ними, будь то передача, хранение или представление.

Полнота –свойство информации, показывающее соотношение имеющейся в наличии информации ко всей полезной информации или свойство информации содержать в себе необходимый минимальный объём информации для принятия взвешенного решения. Критерием полноты информации выступает так называемый период полудоступности: чем данный период меньше, тем медленнее устаревает информация, что, в свою очередь, способствует ее раскрытию в большем объеме.

9 вопрос Понятие «информационная система» в логическом и физическом аспектах.

10Информационный процесс. Типы и виды операций над данными (информацией).

Информационная система(ИС) – это организационно-упорядоченная взаимосвязанная совокупность средств, методов и персонала, используемых для хранения, обработки и выдачи информации в интересах достижения поставленной цели. Современное понимание информационной системы предполагает использование в качестве основного технического средства переработки информации персонального компьютера. ИС невозможно представить (немыслима) без персонала, взаимодействующего с компьютерами и телекоммуникациями.

Процессы, обеспечивающие работу ИС любого назначения, условно можно представить в виде схемы, состоящей из блоков:

· ввод информации из внешних или внутренних источников;

· обработка входной информации и представление ее в удобном виде;

· вывод информации для представления потребителям или передачи в другую систему;

ИС определяется следующими свойствами:

· может быть подвергнута анализу, построена и управляема на основе общих принципов построения систем;

· является динамичной и развивающейся;

· при построении необходимо использовать СИСТЕМНЫЙ ПОДХОД;

· выходной продукцией является информация, на основе которой принимаются решения;

· следует воспринимать как автоматизированную, т.е. человеко-компьютерную систему обработки информации.

В настоящее время сложилось мнение об информационной системе как о системе, реализованной с помощью компьютерной техники. Хотя в общем случае информационную систему можно понимать и в некомпьютерном варианте.

· получению более рациональных вариантов решения поставленных задач за счет внедрения математических методов и интеллектуальных систем и т.д.;

· освобождению работников от рутинной работы за счет ее автоматизации;

· повышение качества производимых товаров и услуг;

· обеспечению достоверности информации;

· замене бумажных носителей данных на магнитные/оптические диски, что приводит к более рациональной организации переработки информации на компьютере и снижению объемов документов на бумаге;

· совершенствованию структуры потоков информации и системы документооборота;

уменьшению затрат на производство продуктов и услуг.

· уменьшение затрат на производство продуктов и услуг;

· предоставление потребителям уникальных услуг;

· отыскание новых рыночных ниш;

· привязка к фирме покупателей и поставщиков за счет предоставления им разных скидок и услуг.

Это и есть цели создания ИС(АСОИ) (что можно ожидать (эффект) от внедрения ИС).

Операции и процедуры различаются по ряду признаков и подразделяются на:

· по содержанию: информационные; логико-мыслительные; организационные.

· по степени повторяемости: повторяющиеся; неповторяющиеся.

· по уровню механовооруженности: ручные; механизированные; автоматизированные; машинно-ручные.

· по характеру сочетания во времени: последовательные; параллельные; последовательно-параллельные.

12 и 13 и 14.вопрос Теория информации, теория алгоритмов и теория автоматов как кибернетические

дисциплины.

К теории информации относят результаты решения ряда фундаментальных теоретических вопросов:

— анализ сигналов как средства передачи сообщений, включающий вопросы оценки переносимого ими «количества информации»;

— анализ информационных характеристик источников сообщений и каналов связи и обоснование принципиальной возможности кодирования и декодирования сообщений, обеспечивающих предельно допустимую скорость передачи сообщений по каналу связи, как при отсутствии, так и при наличии помех.

В теории информации исследуются информационные системы при четко сформулированных условиях (постулатах):

· Источник сообщения осуществляет выбор сообщения из некоторого множества с определенной вероятностью.

· Сообщения могут передаваться по каналу связи в закодированном виде. Правило декодирования известно декодеру (записано в его программе).

· Сообщения следуют друг за другом, причем число сообщений может быть сколь угодно большим.

· Сообщение считается принятым верно, если в результате декодирования оно может быть в точности восстановлено.

· Количество информации не зависит от смыслового содержания сообщения, от его эмоционального воздействия, полезности и даже от его отношения к реальной действительности.

Теория алгоритмов как отдельный раздел математики, изучающий общие свойства алгоритмов, возникла в 30-х годах 20 века. Алгоритмы, однако, прослеживаются в математике в течение всего времени ее существования. Необходимость точного математического уточнения интуитивного понятия алгоритма стала неизбежной после осознания невозможности существования алгоритмов решения многих массовых проблем, в первую очередь связанных с арифметикой и математической логикой. Для доказательства несуществования алгоритма надо иметь его точное математическое определение, поэтому после сформирования понятия алгоритма как новой и отдельной сущности первоочередной стала проблема нахождения адекватных формальных моделей алгоритма и исследования их свойств. При этом формальные модели были предложены как для первоначального понятия алгоритма, так и для производного понятия алгоритмически вычисляемой функции.

Лекция 1. Сейчас имеется несколько (даже много) определений понятия «информация» и ни одно из них не является общепринятым

ОСНОВНЫЕ ПОНЯТИЯ ДИНАМИЧЕСКОЙ ТЕОРИИ ИНФОРМАЦИИ

Сейчас имеется несколько (даже много) определений понятия «информация» и ни одно из них не является общепринятым. Это естественно, поскольку общепризнанные определения появляются в науке, когда она становится классической и перестает развиваться. О науке об информации этого, к счастью, сказать нельзя. Нужно ли вообще определять это понятие? Вопрос не праздный, поскольку многие ученые придерживаются мнения о том, что «информация есть информация и ничто другое и этого достаточно». Действительно, до недавнего времени слово «информация» использовалось в обыденной жизни и в практических задачах (шифровка, связь и т.д.). Там было достаточно понимания о чем идет речь на интуитивном или сугубо прикладном уровне. В последнее время стало ясно, что информация играет в науке фундаментальную роль. Возникла потребность понять, что же это такое? Попытки связать информацию с привычными понятиями материя или энергия успехом не увенчались. Стало ясно, «информация есть информация, а не материя и не энергия». (Н. Винер [1]). Отрицание не может претендовать на роль определения, вместе с тем в данном случае оно существенно, ибо указывает на отсутствие вещественного (и/или полевого) происхождения информации. Попытки связать информацию с энтропией тоже оказались безуспешными, хотя они продолжаются до сих пор (подробнее мы это вопрос обсудим позже). Поэтому вопрос об определении понятия «информация» остается открытым. В книге И.В. Мелик-Гайказян [2] собрана коллекция определений слова «информация», которая обсуждалась в [3], ниже мы будем следовать этим работам.

1.1 Определения понятия «информация

«информация означает порядок, коммуникация есть создание порядка из беспорядка или по крайней мере увеличение степени той упорядоченности, которая существовала до получения сообщения» [7].

Приводимые ниже определения в известной мере повторяются.

«информация...- одно из свойств предметов, явлений, процессов объективной действительности, созданных человеком управляющих машин, заключающееся в способности воспринимать внутреннее состояние и воздействие окружающей среды и сохранять определенное время результаты его; передавать сведения о внутреннем состоянии и накопленные данные другим предметам, явлениям и процессам» [9];

«информация есть текущие данные о переменных величинах в некоей области деятельности, систематизированные сведения относительно основных причинных связей, которые содержатся в знании как понятии более общего класса, по отношению к которому информация является подчиненной» [4];

«информация есть знание о каком-то особом событии, случае или о чем-либо подобном» [4];·

«информацией являются все те данные о внешнем мире, которые мы получаем как путем непосредственного воздействия на наши органы чувств окружающих предметов и явлений, так и опосредованным путем через книги, газеты, рассказы других людей» [11];

«информацией называется всякое сообщение или передача сведений о чем-либо, что заранее не было известно» [12].

У философов популярны дефиниции, содержащие термин «отражение»:

«информация есть отражение в сознании людей объективных причинно-следственных связей в окружающем нас реальном мире» [14];

«информация не тождественна отражению, а есть лишь его инвариантная часть, поддающаяся определению, объективированию, передаче» [16].

Определения такого типа можно обобщить в виде утверждения:

«информация есть отражение отображения наших соображений».

Такого определения в литературе нет. По стилю оно соответствует творениям Кузьмы Пруткова (например, его миниатюре «Спор древнегреческих ученых о прекрасном»). Тем не менее, по глубине и смыслу (если кто-либо попытается его в нем найти), оно не уступает приведенным выше. В философском энциклопедическом словаре (1983 г.) приведено:

В связи с трудностями философского определения понятия «информация» возникло убеждение в том, что оно не может быть отнесено к разряду философских категорий с заменой ею отражения (П. Копнин, [20]).

«информация. есть план строения клетки и, следовательно, всего организма» [21]. Модификация этого определения содержится в работе Э. Янча, трактовавшего информацию как «инструкцию» к самоорганизации в процессе эволюции биологических структур [22].

В работе В. Корогодина [23] приводятся определения:· «информация есть некий алгоритм» «совокупность приемов, правил или сведений, необходимых для построения оператора, будем называть информацией». Под словом «оператор» здесь понимается некое стороннее воздействие на систему, изменяющее спонтанный ход событий. Большое число похожих и непохожих друг на друга определений понятия «информация» означает, что общепринятого определения ещё нет. Более того, нет даже четкого понимания сути этого явления, хотя потребность в нем уже назрела. Сейчас область применимости информационного подхода существенно расширилась. Понятие «информация» используется при исследовании практически всех процессов самоорганизации (в частности биологической эволюции). При этом актуальным становится вопрос о возникновении информации и эволюции её ценности и здесь без определения понятий уже не обойтись. Выбор определения зависит от аппарата исследования, иными словами, определение должно быть конструктивным, то есть пригодным для использования в рамках аппарата. Мы будем использовать аппарат теории динамических систем, поскольку именно он лежит в основе науки о самоорганизации (то есть синергетики). Этим условиям в наибольшей степени удовлетворяет определение информации, предложенное Генри Кастлером [24].

Информация есть случайный и запомненный выбор одного варианта из нескольких возможных и равноправных.

Здесь слово «случайный» выделено, поскольку оно относится к процессу (способу) выбора и потому сужает область применимости определения. Вообще говоря, выбор может быть и не случайным (подсказанным), в этом случае говорят о рецепции информации. Случайный выбор соответствует генерации (то есть спонтанному возникновению) информации. Поэтому слово «случайный» мы в определении информации опустим, но учтем его при обсуждении процессов генерации и рецепции.

Информация есть запомненный выбор одного варианта из нескольких возможных и равноправных. (Q)

(G. Quastler)

Будем использовать это определение и ссылаться на него как на дефиницию (Q).

Проблемы определения термина «информация»

Введение

информация информатика концепция

Договорившись о значении этого понятия, можно избежать неверных, и от этого бесполезных, а иногда и опасных, выводов в различных областях наук, хотя понимание сущности информации в широком смысле может войти вразрез или существенно отличаться от частных его значений, принятых в конкретных областях деятельности человека.

Ниже приведено краткое описание основных философских концепций теории информации, описаны сложности, с которыми сталкиваются при определении этого термина. В качестве основной науки, изучающей информацию и информационные процессы, рассмотрена информатика. Перечислены основные проблемы и аспекты, изучаемые информатикой, показано место этой науки в системе научных знаний.

Глава 1.

Понятие информации

информация философия наука

Истоки представлений об информации уходят в глубь веков. Издавна слово «информация» связывалось с процессами человеческого общения, передачи сведений, сообщений. Первоначально понимание информации связывалось с ее содержательным и аксиологическим аспектами, которые теперь исследуются в рамках семантической и прагматической теорий. Такое положение сохранялось вплоть до 20-х годов ХХ века, когда появились публикации, которые можно считать первыми шагами создании общей теории информации.

Возникновение и дальнейшее бурное развитие теории информации было вызвано в первую очередь практическими потребностями передачи сообщений, ростом ведущих отраслей промышленности связи. Изучение закономерностей передачи сообщений по техническим каналам связи и главным образом сообщений, обслуживающих массовые коммуникации (радио, телефон и др.), привело к появлению статистико-вероятностных методов определения количества передаваемой информации.

В 1948 году Э. Шеннон, Р.А. Фишер и Н. Винер независимо друг от друга предложили статистическое определение количества информации, основанное на теории вероятностей. В основополагающей статье К.Э. Шеннона «Математическая теория связи» содержались важнейшие идеи, принципы и теоремы этой теории. Предпосылками возникновения теории информации Шеннона послужили:

· учение об энтропии;

· исследования в области лингвистики, связанные с изучением частоты использования букв и слов в текстах и естественной речи;

· запись телеграфных сообщений с использованием мнемокодов и других сокращений;

В это же время вышла в свет книга Н. Винера «Кибернетика, или Управление и связь в животном и машине», центральное место которой также составляют идеи теории информации. В этих и последующих работах основное внимание уделялось изучению количественного аспекта информации, то есть прежде всего математической теории информации, что сыграло существенную роль в выяснении природы информации. Результаты этих и многих других исследований предопределили успехи в развитии различных мировоззренческих и философских интерпретаций понятия информации.

Проблемы определения термина «информация»

Универсальность сущности информации является из основных проблем общей теории информации. При этом выделяют различные аспекты этой проблемы, которые можно сформулировать как следующие вопросы:

· Является ли информация универсальным свойством реальности?

· Является ли информация универсальным свойством всех объектов реальности или она присуща только живым самоорганизующимся структурам (таким как организмы, человек, общество)?

· Является ли информация отличительным свойством процессов, в которых присутствует механизм управления?

Если судить о содержательном подходе к определению термина «информация», то в частных науках при исследовании объекта или явления к ней относят то, что принимается за информацию в соответствие с выявленными признаками и свойствами этого объекта или явления.

Использование категории «информация» в сложных теоретических конструкциях приводит к тому, что:

· каждая отдельная научная область знания претендует на самодостаточное понимание и выражение смысла информации как таковой, в результате чего данный термин употребляется в разных смыслах;

· возникает путаница между различными теоретическими системами, использующими данный термин «информация» в различных смыслах и контекстах;

· возникает ситуация, неадекватного понимания природы и сущности информации.

В связи с этим необходимо:

· выявление закономерностей развития понятия «информация», происходящего по мере изменения человеческих представлений об информационной реальности в целом;

· точное определение смысловых аспектов термина «информация», что необходимо для соответствующего определения неразрывно с нею связанного термина «информационная реальность», так как от определения термина «информация» будет зависеть то, каким содержанием наполняется понятие «информационная реальность» и то, каким образом выражается сущность теории информации.

Определение природы информации, с одной стороны, связано с выявлением соответствующих видов информационной реальности, а с другой стороны, исследование конкретных видов информационной реальности позволяет провести уточнение важных аспектов проблемы природы информации. Информация и информационный подход образуют единство, состоящее в том, что информационный подход обязательно связан с использованием понятия информации, а информация не существует вне информационного подхода.

Автор работы [1] подразделяет информацию на следующие виды:

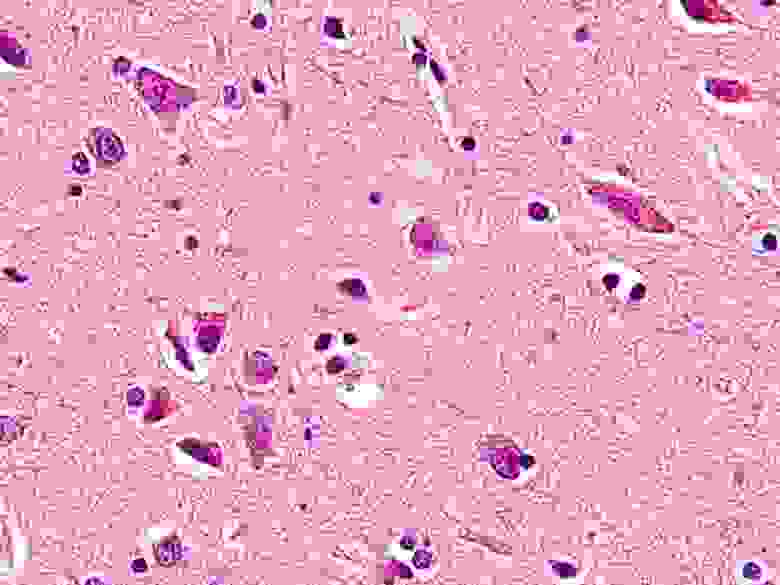

· Биоинформационная специфика проявляется в соответствующих процессах передачи наследственной информации, при воспроизводстве живых организмов.

· Техноинформация как термин обозначает способ использования, записи, обработки, сохранения и преобразования в определенной системе технических устройств.

· Гносеоинформация как термин отражает специфику информационных процессов, связанных с человеческим познанием реальности.

Важно при этом отметить, что и как именно изменяется в общем представлении об информации в результате развития представлений об отдельных ее сторонах и свойствах. Смысловое пространство термина «информация» определяется сложным взаимодействием субъекта, осуществляющего познавательное отношение к реальности, и собственно объекта познания.

Рассматривая становление различных способов понимания информации, можно отметить развитие методологического процесса, свойственного этим подходам. Развитие представлений о природе информации и резкое повышение статуса наук, изучающих ее, привело к возникновению различных философских теорий информации, стремящихся дать свою интерпретацию данного явления. Многие трактовки сущности информации соответствуют общему характеру концептуальных представлений, сложившихся в их рамках.

Что такое информация?

Исследование How Much Information, проведенное в 2009 году показало, что количество потребляемой в неделю информации с 1986 года выросло в 5 раз. С 250 тысяч слов в неделю до 1,25 миллиона! С тех пор это цифра увеличилась в разы. Далее следуют ошеломительные показатели: в 2018 году количество интернет-пользователей и пользователей социальных сетей — 4.021 млрд и 3.196 млрд. Современный человек за день анализирует невероятное количество информации, применяя различные схемы и стратегии по ее обработке, для принятия выгодных решений. Человеческий вид сгенерировал 90% информации в этом мире за два последних года. Сейчас, если округлять, в день мы производим порядка 2,5 квинтильонов байт (2,5 * 10^18 байт) новой информации. Если разделить это число на количество живущих сейчас людей, то получится, что в среднем один человек за день создает 0,3 гигабайта информации.

Сколько информации занимают Homo sapiens? (далее Homo). Для простоты в информатике придумали термин под названием бит. Бит – это минимальная единица информации. Файл с этой работой занимает несколько килобайт. Такой документ пятьдесят лет назад занял бы всю память самого мощного компьютера. Средняя книга в цифровом варианте занимает в тысячу раз больше места и это уже мегабайт. Качественное фото на мощный фотоаппарат – 20 мегабайт. Один цифровой диск в 40 раз больше. Интересные масштабы начинаются с гигабайтов. ДНК человека, вся информация о нас с вами равна около 1,5 гигабайта. Умножаем это на семь миллиардов и получаем 1,05х10^19 байт. В целом, такой объем информации в современных условиях мы можем произвести за 10 дней. Это количество битов опишет всех живущих сейчас людей. И это только данные о самих людях, без взаимодействий между ними, без взаимодействий с природой и культурой, которую человек сам для себя создал. Насколько увеличится эта цифра, если добавлять переменные и неопределенности будущего? Хаос будет подходящим словом.

Информация обладает удивительным свойством. Даже когда ее нет, она есть. И здесь нужен пример. В поведенческой биологии есть знаменитый эксперимент. Друг напротив друга стоит две клетки. В 1-ой обезьяна высокого ранга. Альфа-самец. Во 2-ой клетке обезьяна статусом ниже, бета-самец. Обе обезьяны могут наблюдать за своим визави. Добавим в эксперимент фактор влияния. Между двумя клетками кладем банан. Бета-самец не посмеет взять банан, если знает, что альфа-самец тоже видел этот банан. Ибо он сразу прочувствует всю агрессию альфа-самца. Далее немного изменяют первоначальные условия опыта. Клетку альфа-самца накрывают непрозрачной тканью, чтобы лишить его обзора. Повторяя все то, что сделали до этого, картина становится совершенно иной. Бета-самец без каких-либо угрызений совести подходит и берет банан.

Все дело в его умении анализировать, он знает о том, что альфа-самец не видел, как положили банан и для него банана просто не существует. Бета-самец проанализировал факт отсутствия сигнала о появлении информации о банане у альфа-самца и воспользовался ситуацией. Постановка конкретного диагноза пациенту во многих случаях производится при нахождении у него определенных симптомов, однако огромное количество заболеваний, вирусов и бактерий может поставить даже опытного врача в тупик, как ему определить точный диагноз, не потратив время, которое может быть жизненно важно для пациента? Все просто. Он производит анализ не только по тем симптомам, которые есть у больного, но и по тем, которых у него нет, что сокращает время поиска в десятки раз. Если что-то не подает тот или иной сигнал, это тоже несет определенную информацию – как правило, негативного характера, но не всегда. Анализируйте не только информационные сигналы, которые есть, но и те, которых нет.

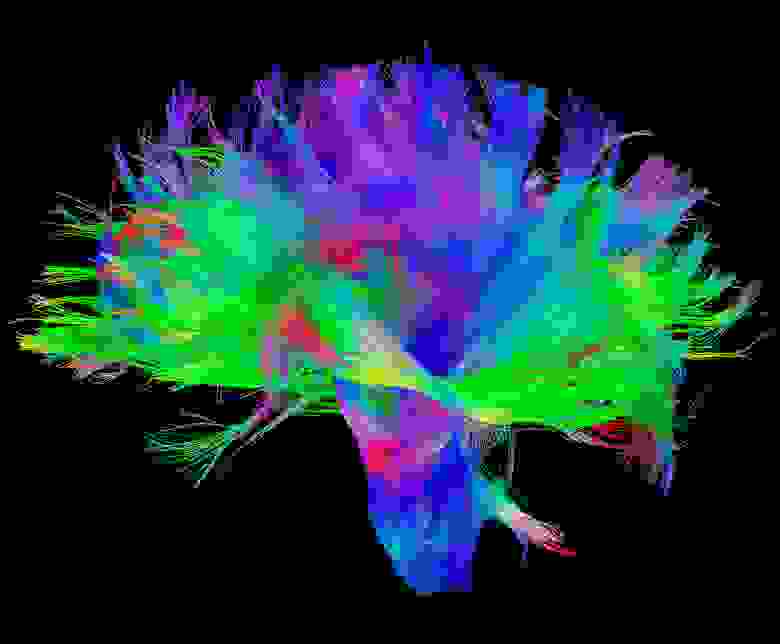

Эти примеры, добавляют нулей и единичек в цифры выше. В связи с перечисленными цифрами и проблемами возникает ряд вопросов. Как? Как этого удалось достигнуть? Способен ли организм/общество нормально функционировать в таких условиях. Как информация влияет на биологические, экономические и другие виды систем. Объем информации, который мы воспринимаем в 2019 году, покажется мизерным для потомков из 2050. Уже сейчас вид создает новые схемы и паттерны работы с информацией, изучает ее свойства и воздействие. Фраза: — “за год я прожил миллион лет” уже не шутки и не абсурд, а реальность. Количество информации, которое создает человек, влияет на социальную, экономическую, культурную и даже биологическую жизнь. В 1980 года мечтали создать квантовый компьютер для увеличения вычислительных мощностей. Мечта вида. Открытия, которое сулило это изобретение, должны были предвосхитить новую эру. В 2018 году IBM запустил в продажу первый коммерческий квантовый компьютер, но этого уже никто не заметил. Новость обсуждали невероятно малое количество людей. Она просто утонула в том информационном изобилии, в котором мы сейчас существуем. Основным направлением исследований в последние годы стали нейронауки, алгоритмы, математические модели, искусственный интеллект, что в целом говорит о поиске возможности нормального функционирования в обогащенной информацией среде. В 1929 году открыли нейроны фон Экономо, которые встречаются только у высокосоциальных групп животных. Есть прямой коррелят размера группы и размера мозга, чем больше группа животных, тем больше у них размер мозга относительно тела. Неудивительно, что нейроны фон Экономо встречаются только у китообразных, слонов и приматов. Нейроны фон Экономо отвечают за передачу больших объемов информации в мозге.

пока А.Г. Лукашенко не запретил им общаться, посмотри на них

Сколько потребовалось времени, чтобы связать эти два события? Долгое время роды вообще не связывали с половыми актами между мужчиной и женщиной. В большинстве культур и религий за рождение новой жизни отвечали боги. Точная дата открытия этой закономерности, к сожалению, так и не установлена. Однако стоит отметить, что до сих пор существуют закрытые общества охотников-собирателей, которые эти процессы не связывают, а за рождение в них отвечают особые ритуалы в исполнении шамана. Основной причиной детской смертности при родах до 1920 были грязные руки. Чистые руки и живой ребенок тоже пример неочевидной закономерности. Вот еще один пример закономерности, которая до 1930 года оставалась неявной. О чем речь? О группах крови. В 1930 году Ландштейнер получил за это открытие Нобелевскую премию. До этого момента знание о том, что переливать человеку можно ту группу крови, которая совпадает у донора с нуждающимся — было неясным. Подобных примеров тысячи. Стоит отметить, что поиск закономерностей то, чем вид занимается постоянно. Бизнесмен, который находит закономерность в поведении или потребности людей, а после зарабатывает на этой закономерности долгие годы. Серьезные научные исследования, которые позволяют прогнозировать изменение климата, миграцию людей, нахождение мест для добычи полезных ископаемых, цикличность комет, развитие эмбриона, эволюция вирусов и как верхушка, поведение нейронов в мозге. Конечно, можно все объяснить устройством вселенной, в которой мы живем, и вторым законом термодинамики о том, что энтропия постоянно возрастает, но этот уровень для практических целей не подходит. Следует выбрать более приближенный к жизни. Уровень биологии и информатики.

Что такое информация? Согласно распространённым представлениям, информация – это сведения независимо от формы их представления или решение проблемы неопределённости. В физике информация – это мера упорядоченности системы. В теории информации, определение этого термина следующее: информация – это данные, биты, факты или понятия, набор значений. Все эти понятия размыты и неточны, более того, я считаю, что немного ошибочны.

В доказательство этого выдвинем тезис — информация сама по себе бессмысленна. Что такое число “3”? Или что такое буква “А”? Символ без приписанного значения. Но что такое число “3” в графе группы крови? Это значение, которое спасет жизнь. Оно уже влияет на стратегию поведения. Пример, доведенный до абсурда, но не теряющий своей значимости. Дуглас Адамс написал “Путеводитель для путешествующих автостопом по галактике”. В этой книге, созданный квантовый компьютер должен был ответить на главный вопрос жизни и Вселенной. В чем смысл жизни и Вселенной? Ответ был получен спустя семь с половиной миллионов лет непрерывных вычислений. Компьютер заключил, многократно проверив значение на правильность, что ответ был “42”. Приведённые примеры дают понять, что информация без внешней среды, в которой она находится (контекста), ничего не значит. Число “2” может означать количество денежных единиц, больных эболой, счастливых детей или быть показателем эрудированности человека в каком-то вопросе. Для дальнейшего доказательства перейдем в мир биологии: листья растений часто имеют форму полукруга и сперва как бы поднимаются вверх, расширяясь, но после определенной точки преломления, тянутся вниз, сужаясь. В ДНК, как в главном носители информации или значений, нет гена, который кодировал бы их такую тягу вниз, после определенной точки. То, что лист растения тянется вниз, проделки гравитации.

Сама по себе ДНК, что у растений, что у млекопитающих, что уже у упомянутого Homo Sapiens, несет мало информации, если вообще это делает. ДНК — это набор значений в определенной среде. ДНК, в основном, несет факторы транскрипции, то что должно быть активировано определенной внешней средой. Помести ДНК растения/человека в среду с другой атмосферой или гравитацией, и на выходе получится другой продукт. Поэтому передавать инопланетным формам жизни нашу ДНК для исследовательских целей — довольно глупое занятие. Вполне возможно, в их среде, ДНК человека вырастет в нечто, что более ужасающе, чем двуногий прямоходящий примат с оттопыренным большим пальцем и идеями о равенстве. Информация — это значения/данные/биты/материя в любой форме и в непрерывной связи с окружающей средой, системой или контекстом. Информация не существует без факторов внешней среды, системы или контекста. Только в неразрывной связке с этими условиями, информация способна передавать смыслы. Говоря языком математики или биологии, информация не существует без внешней среды или систем, на переменные которых она оказывает влияние. Информация всегда является придатком тех обстоятельств, в которых она перемещается. В этой статье будут рассмотрены основные идеи теории информации. Труды интеллектуальной деятельности Клода Шеннона, Ричарда Фейнмана.

Отличительной особенностью вида является способность создавать абстракции и выстраивать закономерности. Представлять одни явления через другие. Мы кодируем. Фотоны на сетчатке глаза создают картинки, колебания воздуха преобразовываются в звуки. Определенный звук мы связываем с определенной картинкой. Химический элемент в воздухе, своими рецепторами в носу, мы интерпретируем, как запах. Через рисунки, картинки, иероглифы и звуки мы можем связывать события и передавать информацию.

вот он собственно говоря и кодирует твою реальность

Подобное кодирование и абстракции не стоит недооценивать, достаточно только вспомнить, насколько сильно оно влияет на людей. Кодировки способны одержать верх над биологическими программами, человек ради идеи (картинки в голове, которая определяет стратегию поведения) отказывается от передачи копий своих генов дальше. Или вспомнить всю мощь физических формул, позволивших отправить представителя вида в космос. Химические уравнения, которые помогают лечить людей и так далее. Более того, мы можем кодировать то, что уже закодировано. Простейшим примером может послужить перевод с одного языка на другой. Один код представляется в форме другого. Простота трансформации, как главный фактор успешности этого процесса, позволяет делать его бесконечным. Можно перевести выражение с японского на русский, с русского на испанский, с испанского на двоичную систему, с нее в азбуку Морзе, после представить это в виде шрифта Брайля, потом в форме компьютерного кода, а после в виде электрических импульсов пустить это прямо в мозг, где он декодирует сообщение. Недавно сделали обратный процесс и декодировали активность мозга в речь.

зафигачили в картинку выше электроды и считали всю твою уникальность

В период от сорока до двадцати тысяч лет назад первобытные люди начали активно кодировать информацию в виде речевых или жестовых кодов, наскальных живописей. Современные люди, наблюдая первые наскальные рисунки, пытаются определить (декодировать) их смысл, поиск смыслов — это еще одна отличительная черта вида. Воссоздавая контекст по определённым маркерам или остаткам информации, современные антропологи пытаются понять быт первобытных людей. Квинтэссенция процесса кодирования воплотилась в виде письменности. Письменность, разрешила проблему потери информации при ее передаче не только в пространстве, но и во времени. Иероглифы цифр позволяют кодировать вычисления, слова предметы и т.д. Однако, если с точностью проблема решена более-менее эффективно, если конечно же оба участника процесса коммуникации используют одинаковые условные соглашения на трактовку и процесс декодирования одних и тех же символов (иероглифов), то со временем и скоростью передачи печатная письменность потерпела неудачу. Для решения проблемы скорости были изобретены системы радио и телекоммуникаций. Ключевым этапом развития передачи информации можно считать две идеи. Первая — цифровые каналы связи, а вторая — развитие математического аппарата. Цифровые каналы связи решили проблему в скорости передачи информации, а математический аппарат в его точности.

Любой канал имеет определенный уровень шумов и помех, благодаря которым информация приходит с помехами (набор значений и иероглифов искажен, теряется контекст) или вообще не приходит. По мере развития технологий, количество шумов в цифровых каналах связи уменьшалось, но никогда не сводилось к нулю. По мере увеличения расстояния вообще увеличивалось. Ключевая проблема, которую необходимо решить при потере информации в цифровых каналах связи, была обозначена и решена Клодом Шенноном в 1948 году, а также он придумал термин бит. Звучит она следующим образом: — “Пусть источник сообщений имеет энтропию (Н) на одну секунду, а (С) — пропускная способность канала. Если H