Что измеряется энтропией на молекулярном уровне

Энтропия. Энергия Гиббса

Понятие энтропии

Абсолютная энтропия веществ и изменение энтропии в процессах

Стандартная энтропия

Стандартная энтропия образования

Энергия Гиббса

Стандартная энергия Гиббса образования

Энтальпийный, энтропийный фактор и направление процесса

Примеры решения задач

Задачи для самостоятельного решения

Понятие энтропии

Энтропия S – функция состояния системы. Энтропия характеризует меру неупорядоченности (хаотичности) состояния системы. Единицами измерения энтропии являются Дж/(моль·К).

Абсолютная энтропия веществ и изменение энтропии в процессах

При абсолютном нуле температур (Т = 0 К) энтропия идеального кристалла любого чистого простого вещества или соединения равна нулю. Равенство нулю S при 0 К позволяет вычислить абсолютные величины энтропий веществ на основе экспериментальных данных о температурной зависимости теплоемкости.

Изменение энтропии в процессе выражается уравнением:

где S(прод.) и S(исх.) – соответственно абсолютные энтропии продуктов реакции и исходных веществ.

На качественном уровне знак S реакции можно оценить по изменению объема системы ΔV в результате процесса. Знак ΔV определяется по изменению количества вещества газообразных реагентов Δnг. Так, для реакции

(Δnг = 1) ΔV > 0, значит, ΔS > 0.

Стандартная энтропия

Величины энтропии принято относить к стандартному состоянию. Чаще всего значения S рассматриваются при Р = 101,325 кПа (1 атм) и температуре Т = 298,15 К (25 о С). Энтропия в этом случае обозначается S о 298 и называется стандартной энтропией при Т = 298,15 К. Следует подчеркнуть, что энтропия вещества S (S о ) увеличивается при повышении температуры.

Стандартная энтропия образования

Стандартная энтропия образования ΔS о f,298 (или ΔS о обр,298) – это изменение энтропии в процессе образования данного вещества (обычно 1 моль), находящегося в стандартном состоянии, из простых веществ, также находящихся в стандартном состоянии.

Энергия Гиббса

Энергия Гиббса G – функция состояния системы. Энергия Гиббса равна:

Абсолютное значение энергии Гиббса определить невозможно, однако можно вычислить изменение δG в результате протекания процесса.

Критерий самопроизвольного протекания процесса: в системах, находящихся при Р, Т = const, самопроизвольно могут протекать только процессы, сопровождающиеся уменьшением энергии Гиббса (ΔG

Стандартная энергия Гиббса образования

Стандартная энергия Гиббса образования δG о f,298 (или δG о обр,298) – это изменение энергии Гиббса в процессе образования данного вещества (обычно 1 моль), находящегося в стандартном состоянии, из простых веществ, также находящихся в стандартном состоянии, причем простые вещества пристутствуют в наиболее термодинамически устойчивых состояниях при данной температуре.

Для простых веществ, находящихся в термодинамически наиболее устойчивой форме, δG о f,298 = 0.

Энтальпийный, энтропийный фактор и направление процесса

Проанализируем уравнение ΔG о Т = ΔН о Т — ΔТS о Т. При низких температурах ТΔS о Т мало. Поэтому знак ΔG о Т определяется в основном значением ΔН о Т (энтальпийный фактор). При высоких температурах ТΔS о Т – большая величина, знак Δ G о Т определяется и энтропийным фактором. В зависимости от соотношения энтальпийного (ΔН о Т) и энтропийного (ТΔS о Т) факторов существует четыре варианта процессов.

Примеры решения задач

Задача 1. Используя термодинамические справочные данные, вычислить при 298,15 К изменение энтропии в реакции:

Решение. Значения стандартных энтропий исходных веществ и продуктов реакции приведены ниже:

| Вещество | NH3(г) | O2(г) | NО(г) | H2O(ж) |

| S о 298, Дж/(моль·К) | 192,66 | 205,04 | 210,64 | 69,95 |

В данной реакции ΔV o х.р.,298

Задача 2. Используя справочные термодинамические данные, рассчитать стандартную энтропию образования NH4NO3(к). Отличается ли стандартная энтропия образования NH4NO3(к) от стандартной энтропии этого соединения?

Решение. Стандартной энтропии образования NH4NO3 отвечает изменение энтропии в процессе:

Значения стандартных энтропий исходных веществ и продуктов реакции приведены ниже:

| Вещество | N2(г) | H2(г) | O2(г) | NH4NO3(к) |

| S о 298, Дж/(моль·К) | 191,50 | 130,52 | 205,04 | 151,04 |

Стандартная энтропия образования NH4NO3(к), равная — 609,06 Дж/(моль·К), отличается от стандартной энтропии нитрата аммония S о 298(NH4NO3(к)) = +151,04 Дж/(моль·К) и по величине, и по знаку. Следует помнить, что стандартные энтропии веществ S о 298 всегда больше нуля, в то время как величины ΔS 0 f,298, как правило, знакопеременны.

Задача 3. Изменение энергии Гиббса реакции:

равно δG о 298= –474,46 кДж. Не проводя термодинамические расчеты, определить, за счет какого фактора (энтальпийного или энтропийного) протекает эта реакция при 298 К и как будет влиять повышение температуры на протекание этой реакции.

Решение. Поскольку протекание рассматриваемой реакции сопровождается существенным уменьшением объема (из 67,2 л (н.у.) исходных веществ образуется 36 мл жидкой воды), изменение энтропии реакции ΔS о о 298 реакции меньше нуля, то она может протекать при температуре 298 К только за счет энтальпийного фактора. Повышение температуры уменьшает равновесный выход воды, поскольку ТΔS о

Задача 4. Используя справочные термодинамические данные, определить может ли при 298,15 К самопроизвольно протекать реакция:

Если реакция не будет самопроизвольно протекать при 298,15 К, оценить возможность ее протекания при более высоких температурах.

Решение. Значения стандартных энергий Гиббса и энтропий исходных веществ и продуктов реакции приведены ниже:

ΔG о х.р.,298 > 0, следовательно, при Т = 298,15 К реакция самопроизвольно протекать не будет.

Поскольку ΔS о х.р.,298 > 0, то при температуре Т>ΔН о /ΔS о величина ΔG о х.р.,298 станет величиной отрицательной и процесс сможет протекать самопроизвольно.

Задача 5. Пользуясь справочными данными по ΔG о f,298 и S о 298, определите ΔH о 298 реакции:

Решение. Значения стандартных энергий Гиббса и энтропий исходных веществ и продуктов реакции приведены ниже:

| Вещество | N2O(г) | H2(г) | N2H4(г) | H2O(ж) |

| ΔG о f,298, кДж/моль | 104,12 | 0 | 159,10 | -237,23 |

| S о 298, Дж/(моль·К) | 219,83 | 130,52 | 238,50 | 69,95 |

ΔG о 298 = ΔН о 298 – ТΔS о 298. Подставляя в это уравнение величины ΔН о 298 и ТΔS о 298, получаем:

ΔН о 298 = –182,25× 10 3 + 298·(–302,94) = –272526,12 Дж = – 272,53 кДж.

Следует подчеркнуть, что поскольку ΔS о 298 выражена в Дж/(моль× К), то при проведении расчетов ΔG 0 298 необходимо также выразить в Дж или величину ΔS 0 298 представить в кДж/(мольK).

Задачи для самостоятельного решения

1. Используя справочные данные, определите стандартную энтропию образования ΔS о f,298 NaHCO3(к).

2. Выберите процесс, изменение энергии Гиббса которого соответствует стандартной энергии Гиббса образования NO2(г):

Что измеряется энтропией на молекулярном уровне

– Валяться нужно, – с глубокой убеждённостью отвечал Горбовский.

– Это философски необходимо. Бессмысленные движения руками и ногами неуклонно увеличивают энтропию Вселенной. Я хотел бы сказать миру: «Люди! Больше лежите! Бойтесь тепловой смерти!»

Аркадий и Борис Стругацкие. Полдень, XXII век

Мы убедились в том, что в естественных природных процессах постоянно происходит переход свободной энергии в связанную, а степень хаотичности движения молекул постоянно возрастает. По-видимому, требуется найти величину, которая бы позволила измерить соотношение обоих видов энергии и служить мерой её необратимого рассеивания. Такая величина была введена в 1865 г. Р. Клаузиусом и названа энтропией (от греч. «энтропиа» – внутреннее движение) (рис. 15).

Клаузиус определил изменение энтропии как отношение изменения общей теплоты в системе к её абсолютной температуре:

S = Q/T.

Следовательно, по мере поступления в систему теплоты её энтропия будет возрастать, а по мере потери теплоты – уменьшаться. Но из формулы следует, что степень изменения энтропии зависит ещё и от температуры, при которой происходит этот процесс. Рассмотрим, как изменится энтропия при отдаче или получении теплоты внутри системы.

В предыдущем параграфе мы говорили о том, что все самопроизвольные процессы сопровождаются выравниванием температуры в различных частях системы и переходом части свободной энергии в связанную энергию. Теперь мы видим, что этот процесс неизбежно сопровождается возрастанием некой физической величины, которую называют энтропией. Отсюда можно сделать вывод, что именно энтропия является мерой связанной, не способной совершать работу энергии. Математически это утверждение выражают уравнением Гиббса – Гельмгольца:

U = F + TS,

где U – полная внутренняя энергия, которой обладает система, F – свободная энергия этой системы, а TS – её связанная энергия, которая, как мы видим, равна произведению абсолютной температуры системы на её энтропию.

Это уравнение объединяет первое и второе начала термодинамики. Из него следует, что вся энергия, которой обладает система, не может быть превращена в работу. Работу можно совершать только за счёт затраты свободной энергии, а она, как следует из уравнения Гиббса – Гельмгольца, меньше, чем полная энергия системы:

F = U – TS.

Чем больше энтропия системы, тем меньше доля свободной энергии в полной энергии этой системы, тем меньшую работу она может совершать. Если система изолирована и в ней протекают самопроизвольные процессы, то в соответствии с первым началом термодинамики её полная энергия не меняется. Однако в соответствии со вторым началом её свободная энергия постепенно превращается в связанную.

Вернёмся к вопросу о том, что же всё-таки представляет собой энтропия. Только что мы убедились в том, что увеличение энтропии сопровождается выравниванием температуры в различных частях системы. Однако запас свободной энергии в системе может сохраняться даже в том случае, когда значения температуры во всех её участках равны. Это может быть в случае, когда внутри сосуда, содержащего какой-либо газ, дует ветер. С молекулярной точки зрения это означает, что, хотя средние скорости движения молекул во всех частях сосуда равны по модулю, направление движения этих молекул неодинаково вдоль различных координат. Если ветер дует преимущественно вдоль оси X, то это означает, что средняя скорость движения молекул вдоль этой оси больше, чем вдоль осей Y и Z.

Но если скорости различаются, то энтропия в системе не максимальна, и в ней можно совершить какую-либо работу. Например, можно установить вертушку, которая будет вращаться под действием ветра и производить электрическую энергию. Значит, для того чтобы энтропия стала действительно максимальной, а вся имеющаяся в системе энергия – связанной, необходимо, чтобы не только средние скорости всех молекул были бы одинаковы по абсолютному значению во всех участках системы, но и все направления движения этих молекул были равновероятны.

Такое движение молекул называют беспорядочным или хаотичным. Следовательно, энтропия может служить мерой хаотичности движения молекул или мерой беспорядка в их движении. Такое статистическое обоснование энтропии предложил австрийский физик Людвиг Больцман (1844–1906), заложивший начало науки, которую называют статистической физикой (рис. 16). Однако впоследствии выяснилось, что понятие энтропии выходит далеко за рамки термодинамики и является одним из наиболее фундаментальных в исследовании окружающего нас мира.

1. С какой целью было введено понятие энтропии?

2. Как изменяется энтропия при протекании самопроизвольных процессов?

3. Что обозначают буквы в уравнении Гиббса – Гельмгольца:

U = F + TS?

5. Что измеряется энтропией на молекулярном уровне?

Прочитайте и обсудите в классе научно-фантастический рассказ Айзека Азимова «Последний вопрос», посвящённый «тепловой смерти Вселенной».

Энтропия

Из Википедии — свободной энциклопедии

Энтропи́я (от др.-греч. ἐν «в» + τροπή «обращение; превращение») — широко используемый в естественных и точных науках термин (впервые введён в рамках термодинамики как функция состояния термодинамической системы), обозначающий меру необратимого рассеивания энергии или бесполезности энергии (потому что не всю энергию системы можно использовать для превращения в какую-нибудь полезную работу). Для понятия энтропии в данном разделе физики используют название термодинамическая энтропия; термодинамическая энтропия обычно применяется для описания равновесных (обратимых) процессов.

В статистической физике энтропия характеризует вероятность осуществления какого-либо макроскопического состояния. Кроме физики, термин широко употребляется в математике: теории информации и математической статистике. В этих областях знания энтропия определяется статистически и называется статистической или информационной энтропией. Данное определение энтропии известно также как энтропия Шеннона (в математике) и энтропия Больцмана—Гиббса (в физике).

Хотя понятия термодинамической и информационной энтропии вводятся в рамках различных формализмов, они имеют общий физический смысл — логарифм числа доступных микросостояний системы. Взаимосвязь этих понятий впервые установил Людвиг Больцман. В неравновесных (необратимых) процессах энтропия также служит мерой близости состояния системы к равновесному: чем больше энтропия, тем ближе система к равновесию (в состоянии термодинамического равновесия энтропия системы максимальна).

В широком смысле, в каком слово часто употребляется в быту, энтропия означает меру сложности, хаотичности или неопределённости системы: чем меньше элементы системы подчинены какому-либо порядку, тем выше энтропия.

Энтропия? Это просто!

Этот пост является вольным переводом ответа, который Mark Eichenlaub дал на вопрос What’s an intuitive way to understand entropy?, заданный на сайте Quora

Энтропия. Пожалуй, это одно из самых сложных для понимания понятий, с которым вы можете встретиться в курсе физики, по крайней мере если говорить о физике классической. Мало кто из выпускников физических факультетов может объяснить, что это такое. Большинство проблем с пониманием энтропии, однако, можно снять, если понять одну вещь. Энтропия качественно отличается от других термодинамических величин: таких как давление, объём или внутренняя энергия, потому что является свойством не системы, а того, как мы эту систему рассматриваем. К сожалению в курсе термодинамики её обычно рассматривают наравне с другими термодинамическими функциями, что усугубляет непонимание.

Так что же такое энтропия?

Энтропия — это то, как много информации вам не известно о системе

Например, если вы спросите меня, где я живу, и я отвечу: в России, то моя энтропия для вас будет высока, всё-таки Россия большая страна. Если же я назову вам свой почтовый индекс: 603081, то моя энтропия для вас понизится, поскольку вы получите больше информации.

Почтовый индекс содержит шесть цифр, то есть я дал вам шесть символов информации. Энтропия вашего знания обо мне понизилась приблизительно на 6 символов. (На самом деле, не совсем, потому что некоторые индексы отвечают большему количеству адресов, а некоторые — меньшему, но мы этим пренебрежём).

Или рассмотрим другой пример. Пусть у меня есть десять игральных костей (шестигранных), и выбросив их, я вам сообщаю, что их сумма равна 30. Зная только это, вы не можете сказать, какие конкретно цифры на каждой из костей — вам не хватает информации. Эти конкретные цифры на костях в статистической физике называют микросостояниями, а общую сумму (30 в нашем случае) — макросостоянием. Существует 2 930 455 микросостояний, которые отвечают сумме равной 30. Так что энтропия этого макросостояния равна приблизительно 6,5 символам (половинка появляется из-за того, что при нумерации микросостояний по порядку в седьмом разряде вам доступны не все цифры, а только 0, 1 и 2).

А что если бы я вам сказал, что сумма равна 59? Для этого макросостояния существует всего 10 возможных микросостояний, так что его энтропия равна всего лишь одному символу. Как видите, разные макросостояния имеют разные энтропии.

Пусть теперь я вам скажу, что сумма первых пяти костей 13, а сумма остальных пяти — 17, так что общая сумма снова 30. У вас, однако, в этом случае имеется больше информации, поэтому энтропия системы для вас должна упасть. И, действительно, 13 на пяти костях можно получить 420-ю разными способами, а 17 — 780-ю, то есть полное число микросостояний составит всего лишь 420х780 = 327 600. Энтропия такой системы приблизительно на один символ меньше, чем в первом примере.

Мы измеряем энтропию как количество символов, необходимых для записи числа микросостояний. Математически это количество определяется как логарифм, поэтому обозначив энтропию символом S, а число микросостояний символом Ω, мы можем записать:

Это есть ничто иное как формула Больцмана (с точностью до множителя k, который зависит от выбранных единиц измерения) для энтропии. Если макросостоянию отвечают одно микросостояние, его энтропия по этой формуле равна нулю. Если у вас есть две системы, то полная энтропия равна сумме энтропий каждой из этих систем, потому что log(AB) = log A + log B.

Из приведённого выше описания становится понятно, почему не следует думать об энтропии как о собственном свойстве системы. У системы есть опеделённые внутренняя энергия, импульс, заряд, но у неё нет определённой энтропии: энтропия десяти костей зависит от того, известна вам только их полная сумма, или также и частные суммы пятёрок костей.

Другими словами, энтропия — это то, как мы описываем систему. И это делает её сильно отличной от других величин, с которыми принято работать в физике.

Физический пример: газ под поршнем

Классической системой, которую рассматривают в физике, является газ, находящийся в сосуде под поршнем. Микросостояние газа — это положение и импульс (скорость) каждой его молекулы. Это эквивалентно тому, что вы знаете значение, выпавшее на каждой кости в рассмотренном раньше примере. Макросостояние газа описывается такими величинами как давление, плотность, объём, химический состав. Это как сумма значений, выпавших на костях.

Величины, описывающие макросостояние, могут быть связаны друг с другом через так называемое «уравнение состояния». Именно наличие этой связи позволяет, не зная микросостояний, предсказывать, что будет с нашей системой, если начать её нагревать или перемещать поршень. Для идеального газа уравнение состояния имеет простой вид:

Величины типа давления, температуры и плотности называются усреднёнными, поскольку являются усреднённым проявлением постоянно сменяющих друг друга микросостояний, отвечающих данному макросостоянию (или, вернее, близким к нему макросостояниям). Чтобы узнать в каком микросостоянии находится система, нам надо очень много информации — мы должны знать положение и скорость каждой частицы. Количество этой информации и называется энтропией.

Как меняется энтропия с изменением макросостояния? Это легко понять. Например, если мы немного нагреем газ, то скорость его частиц возрастёт, следовательно, возрастёт и степень нашего незнания об этой скорости, то есть энтропия вырастет. Или, если мы увеличим объём газа, отведя поршень, увеличится степень нашего незнания положения частиц, и энтропия также вырастет.

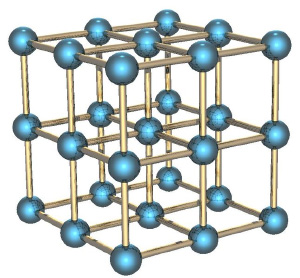

Твёрдые тела и потенциальная энергия

Если мы рассмотрим вместо газа какое-нибудь твёрдое тело, особенно с упорядоченной структурой, как в кристаллах, например, кусок металла, то его энтропия будет невелика. Почему? Потому что зная положение одного атома в такой структуре, вы знаете и положение всех остальных (они же выстроены в правильную кристаллическую структуру), скорости же атомов невелики, потому что они не могут улететь далеко от своего положения и лишь немного колеблются вокруг положения равновесия.

Если кусок металла находится в поле тяготения (например, поднят над поверхностью Земли), то потенциальная энергия каждого атома в металле приблизительно равна потенциальной энергии других атомов, и связанная с этой энергией энтропия низка. Это отличает потенциальную энергию от кинетической, которая для теплового движения может сильно меняться от атома к атому.

Если кусок металла, поднятый на некоторую высоту, отпустить, то его потенциальная энергия будет переходить в кинетическую энергию, но энтропия возрастать практически не будет, потому что все атомы будут двигаться приблизительно одинаково. Но когда кусок упадёт на землю, во время удара атомы металла получат случайное направление движения, и энтропия резко увеличится. Кинетическая энергия направленного движения перейдёт в кинетическую энергию теплового движения. Перед ударом мы приблизительно знали, как движется каждый атом, теперь мы эту информацию потеряли.

Понимаем второй закон термодинамики

Второй закон термодинамики утверждает, что энтропия (замкнутой системы) никогда не уменьшается. Мы теперь можем понять, почему: потому что невозможно внезапно получить больше информации о микросостояниях. Как только вы потеряли некую информацию о микросостоянии (как во время удара куска металла об землю), вы не можете вернуть её назад.

Давайте вернёмся обратно к игральным костям. Вспомним, что макросостояние с суммой 59 имеет очень низкую энтропию, но и получить его не так-то просто. Если бросать кости раз за разом, то будут выпадать те суммы (макросостояния), которым отвечает большее количество микросостояний, то есть будут реализовываться макросостояния с большой энтропией. Самой большой энтропией обладает сумма 35, и именно она и будет выпадать чаще других. Именно об этом и говорит второй закон термодинамики. Любое случайное (неконтролируемое) взаимодействие приводит к росту энтропии, по крайней мере до тех пор, пока она не достигнет своего максимума.

Перемешивание газов

И ещё один пример, чтобы закрепить сказанное. Пусть у нас имеется контейнер, в котором находятся два газа, разделённых расположенной посередине контейнера перегородкой. Назовём молекулы одного газа синими, а другого — красными.

Если открыть перегородку, газы начнут перемешиваться, потому что число микросостояний, в которых газы перемешаны, намного больше, чем микросостояний, в которых они разделены, и все микросостояния, естественно, равновероятны. Когда мы открыли перегородку, для каждой молекулы мы потеряли информацию о том, с какой стороны перегородки она теперь находится. Если молекул было N, то утеряно N бит информации (биты и символы, в данном контексте, это, фактически, одно и тоже, и отличаются только неким постоянным множителем).

Разбираемся с демоном Максвелла

Ну и напоследок рассмотрим решение в рамках нашей парадигмы знаменитого парадокса демона Максвелла. Напомню, что он заключается в следующем. Пусть у нас есть перемешанные газы из синих и красных молекул. Поставим обратно перегородку, проделав в ней небольшое отверстие, в которое посадим воображаемого демона. Его задача — пропускать слева направо только красных, и справа налево только синих. Очевидно, что через некоторое время газы снова будут разделены: все синие молекулы окажутся слева от перегородки, а все красные — справа.

Получается, что наш демон понизил энтропию системы. С демоном ничего не случилось, то есть его энтропия не изменилась, а система у нас была закрытой. Получается, что мы нашли пример, когда второй закон термодинамики не выполняется! Как такое оказалось возможно?

Решается этот парадокс, однако, очень просто. Ведь энтропия — это свойство не системы, а нашего знания об этой системе. Мы с вами знаем о системе мало, поэтому нам и кажется, что её энтропия уменьшается. Но наш демон знает о системе очень много — чтобы разделять молекулы, он должен знать положение и скорость каждой из них (по крайней мере на подлёте к нему). Если он знает о молекулах всё, то с его точки зрения энтропия системы, фактически, равна нулю — у него просто нет недостающей информации о ней. В этом случае энтропия системы как была равна нулю, так и осталась равной нулю, и второй закон термодинамики нигде не нарушился.

Но даже если демон не знает всей информации о микросостоянии системы, ему, как минимум, надо знать цвет подлетающей к нему молекулы, чтобы понять, пропускать её или нет. И если общее число молекул равно N, то демон должен обладать N бит информации о системе — но именно столько информации мы и потеряли, когда открыли перегородку. То есть количество потерянной информации в точности равно количеству информации, которую необходимо получить о системе, чтобы вернуть её в исходное состояние — и это звучит вполне логично, и опять же не противоречит второму закону термодинамики.